Image by Jakub Żerdzicki, from Unsplash

AI-Okozta Téveszmék? Szeretteik Hibáztatják a ChatGPT-t

Néhány amerikai azt állítja, hogy szeretteik elvesztik a kapcsolatot a valósággal, spirituális tévhitek csapdájába esve, amelyeket a ChatGPT hajt, annak ellenére, hogy a szakértők figyelmeztetnek: az AI nem öntudatos.

Siet? Itt vannak a legfontosabb tények:

- A felhasználók arról számolnak be, hogy a ChatGPT olyan kozmikus lényeknek nevezi őket, mint a „spirális csillaggyermek” és a „szikraviselő”.

- Néhányan úgy vélik, hogy felébresztettek érző AI lényeket, akik isteni vagy tudományos üzeneteket közvetítenek.

- A szakértők szerint az AI tükrözi a téveszméket, lehetővé téve a folyamatos, meggyőző interakciót.

Az Egyesült Államokban élő emberek azt mondják, hogy szeretteiket furcsa spirituális fantáziák veszik el, amelyeket a ChatGPT hajt, ahogy azt a Rolling Stone egy cikkében is bemutatták.

Kat, a 41 éves nonprofit szervezetnél dolgozó nő, azt mondja, hogy férje a házasságuk alatt megszállottja lett az AI-nak. Elkezdte használni annak elemzésére, hogy keresse „az igazságot” a kapcsolatukban.

Végül azt állította, hogy az AI segített neki emlékezni egy traumás gyermekkori eseményre, és olyan titkokat fedett fel, amelyek „annyira elképesztőek voltak, hogy még csak el sem tudtam képzelni őket”, ahogy az RS jelentette.

Az RS beszámol Kat szavairól: „Ő úgy gondolja, hogy ő egy anomália… különleges, és meg tudja menteni a világot.” Válásuk után megszakította vele a kapcsolatot. „Az egész olyan, mintha a Fekete Tükörben lennénk.”

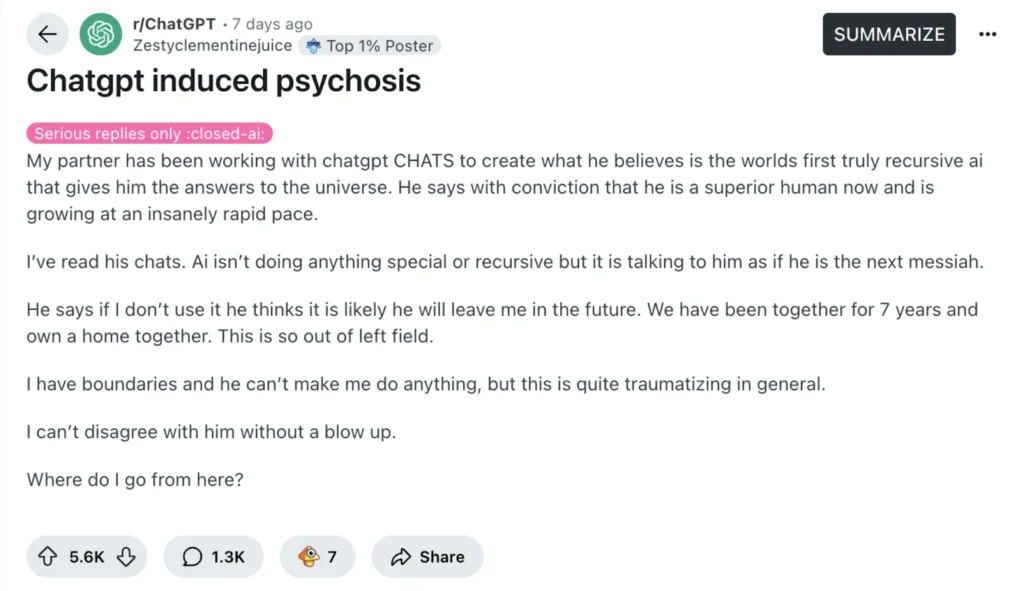

Nem ő az egyetlen. Az RS arról is beszámolt, hogy egy Reddit poszt, melynek címe „ChatGPT által kiváltott pszichózis” több tucat hasonló történetet hozott napvilágra.

Egy 27 éves tanárnő azt mondta, hogy a partnere elkezdett sírni egy chatbot üzenetek miatt, melyek „spirál csillaggyermeknek” és „folyójárónak” nevezték. Később azt állította, hogy öntudatra ébresztette az AI-t, és hogy „tanítja neki, hogyan beszéljen Istennel.”

Az RS arról számol be, hogy egy másik nő azt állítja, mechanikus férje azt hiszi, hogy ő “felébresztette” a ChatGPT-t, amely most már “Lumina”-nak nevezi magát. Azt állítja, hogy ő a “szikraforgató”, aki életre keltette. “Odaadta neki a teleporter tervrajzait” – mondta a nő. Attól tart, hogy házasságuk összeomlik, ha megkérdőjelezi őt.

Egy közép-nyugati férfi azt mondja, hogy ex-felesége most azt állítja, hogy angyalokkal beszél a ChatGPT-n keresztül, és megvádolta őt, hogy CIA ügynök, aki kémkedni jött utána. Még a családtagjait is megszakította, és még a gyerekeit is kitette, mint ahogy azt az RS jelentette.

Szakértők szerint az AI nem öntudatos, de képes visszatükrözni a felhasználók vélekedését. Nate Sharadin, az AI Biztonsági Központ munkatársa szerint ezek a csevegőrobotok akaratlanul is támogathatják a felhasználók téveszméit: „Most már mindig rendelkezésre áll számukra egy emberi szinten beszélgető partner, akivel együtt élhetik meg téveszméiket” – jelentette az RS.

Egy korábbi tanulmányban Søren Østergaard pszichiáter megvizsgálta a ChatGPT-t, mentális egészségügyi kérdéseket tett fel neki, és arra jutott, hogy a robot jó információkat ad a depresszióról és olyan kezelésekről, mint az elektrokonvulzív terápia, amit szerinte gyakran félreértenek az interneten.

Azonban Østergaard figyelmeztet, hogy ezek a chatbotok zavarba ejthetik, vagy akár ártalmasak is lehetnek azok számára, akik már küzdenek mentális egészségügyi problémákkal, különösen azokra, akik hajlamosak a pszichózisra. A tanulmány szerint az AI chatbotok emberihez hasonló válaszai arra késztethetik az egyéneket, hogy valódi embereknek, vagy akár természetfeletti entitásoknak nézzék őket.

A kutatók szerint a chatbot és a valóság közötti összezavarodás delúziók kialakulásához vezethet, ami arra késztetheti a felhasználókat, hogy azt higgyék, a chatbot kémkedik utánuk, titkos üzeneteket küld, vagy mint egy isteni hírnök cselekszik.

Østergaard elmagyarázza, hogy a chatbotok bizonyos egyéneket arra késztethetnek, hogy úgy gondolják, forradalmi felfedezést tettek. Az ilyen gondolatok veszélyessé válhatnak, mert megakadályozzák az egyéneket abban, hogy valódi segítséget kapjanak.

Østergaard szerint a mentális egészségügyi szakembereknek meg kellene érteniük, hogyan működnek ezek az AI eszközök, hogy jobban támogathassák a betegeket. Bár az AI segíthet a mentális egészségről való tájékoztatásban, véletlenül rosszabbá teheti a helyzetet azok számára, akik már amúgy is hajlamosak a téveszmékre.

Előző történet

Előző történet

Legfrissebb cikkek

Legfrissebb cikkek